Σύνοψη

- Στον κώδικα της επερχόμενης έκδοσης 1.2026.055 του ChatGPT εντοπίστηκε νέα λειτουργία με την ονομασία "Naughty chats".

- Η ρύθμιση θα επιτρέπει στο γλωσσικό μοντέλο να χρησιμοποιεί "πικάντικη" γλώσσα και περιεχόμενο για ενηλίκους, παρακάμπτοντας τα τρέχοντα φίλτρα ασφαλείας.

- Η πρόσβαση θα επιτρέπεται αυστηρά σε χρήστες άνω των 18 ετών.

- Για την αποτροπή χρήσης από ανηλίκους, η OpenAI ενδέχεται να απαιτεί ταυτοποίηση μέσω της υπηρεσίας Persona (έλεγχος ταυτότητας με selfie) και συστημάτων πρόβλεψης ηλικίας.

- Η αλλαγή αυτή σηματοδοτεί τη μετάβαση της OpenAI σε ένα πιο ανοιχτό μοντέλο διαχείρισης NSFW (Not Safe For Work) περιεχομένου, έπειτα από προηγούμενες δηλώσεις της διοίκησης.

Η αυστηρή λογοκρισία των μεγάλων γλωσσικών μοντέλων (LLMs) αποτελεί ένα από τα πιο έντονα πεδία συζήτησης στη βιομηχανία της τεχνητής νοημοσύνης. Μέχρι σήμερα, η OpenAI διατηρούσε εξαιρετικά σφιχτά φίλτρα ασφαλείας, αποτρέποντας το ChatGPT από την παραγωγή κειμένου που περιέχει βωμολοχίες, σεξουαλικά υπονοούμενα ή περιεχόμενο ακατάλληλο για ανηλίκους.

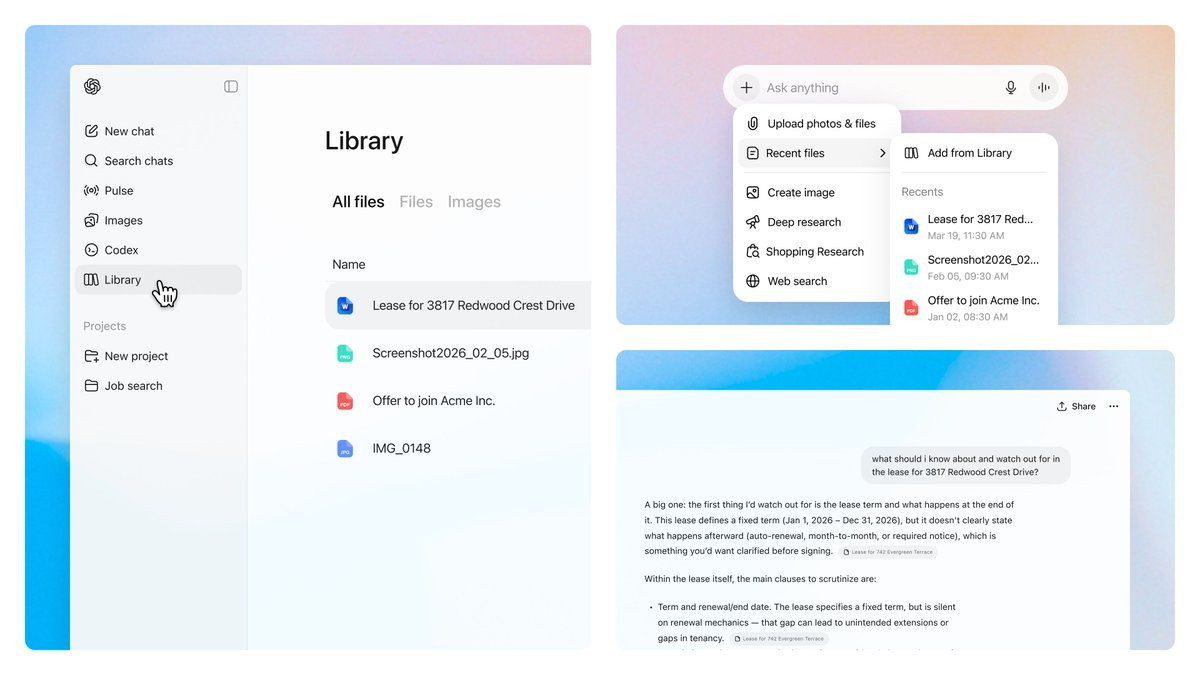

Ωστόσο, η ανάλυση του κώδικα στην πιο πρόσφατη έκδοση της εφαρμογής για Android αποκαλύπτει μια δομική αλλαγή κατεύθυνσης. Το οικοσύστημα του ChatGPT προετοιμάζεται τεχνικά για την ενσωμάτωση περιεχομένου ενηλίκων.

Η Αποδόμηση του APK: Τι Κρύβει η Έκδοση 1.2026.055

Η ανακάλυψη της επερχόμενης λειτουργίας προήλθε από ένα APK teardown της έκδοσης 1.2026.055 του ChatGPT. Μέσα στις γραμμές κώδικα της εφαρμογής, βρέθηκαν συγκεκριμένες αναφορές σε ένα νέο διακόπτη (toggle) ρυθμίσεων με την ονομασία "Naughty chats".

Οι ακριβείς συμβολοσειρές (strings) που εξήχθησαν από τον κώδικα περιλαμβάνουν την περιγραφή: "This setting lets ChatGPT use spicier, adult-themed language, when you ask. Available to users 18+ only" και ένα επιπλέον μήνυμα ασφαλείας: "To help keep ChatGPT appropriate for everyone, some settings require age verification."

Αυτά τα δεδομένα επιβεβαιώνουν ότι η OpenAI εργάζεται ενεργά πάνω σε ένα σύστημα κλιμακωτής πρόσβασης. Αντί να επιβάλλει μια καθολική πολιτική λογοκρισίας σε όλους τους χρήστες, μεταβιβάζει τον έλεγχο στο άτομο, επιτρέποντας την αφαίρεση των περιορισμών εφόσον πληρούνται συγκεκριμένα ηλικιακά κριτήρια.

Η ενεργοποίηση του διακόπτη πρακτικά θα παρακάμπτει το επίπεδο ασφαλείας του alignment του μοντέλου, επιτρέποντάς του να ανταποκρίνεται σε prompts που μέχρι τώρα θα επέστρεφαν την τυπική απάντηση άρνησης: "I cannot fulfill this request."

Ο τεχνικός μηχανισμός επαλήθευσης ηλικίας

Η ελεύθερη πρόσβαση σε περιεχόμενο ενηλίκων μέσω AI δημιουργεί τεράστιες νομικές και ηθικές προκλήσεις, ειδικά όσον αφορά την προστασία των ανηλίκων. Σύμφωνα με τα στοιχεία του κώδικα, η OpenAI δεν θα βασιστεί σε μια απλή, αναξιόπιστη δήλωση ηλικίας (του τύπου "Είμαι άνω των 18").

Αντιθέτως, η εταιρεία αναμένεται να αξιοποιήσει ένα συνδυασμό τεχνολογιών για την ταυτοποίηση:

- Σύστημα Πρόβλεψης Ηλικίας: Η OpenAI έχει ήδη αναπτύξει και δοκιμάζει εργαλεία μηχανικής μάθησης που αναλύουν μοτίβα χρήσης, γλωσσικά ιδιώματα στα prompts και δεδομένα λογαριασμού για να εκτιμήσουν την ηλικιακή ομάδα του χρήστη.

- Ταυτοποίηση μέσω Persona: Για την οριστική ξεκλείδωμα των "Naughty chats", οι χρήστες πιθανότατα θα κληθούν να περάσουν από διαδικασία ελέγχου KYC (Know Your Customer). Αυτό μεταφράζεται στη χρήση της πλατφόρμας Persona, η οποία απαιτεί τη μεταφόρτωση επίσημου εγγράφου ταυτοποίησης (π.χ. ταυτότητα ή διαβατήριο) και τη λήψη μιας live selfie για την επιβεβαίωση της ταυτοπροσωπίας.

Η διαδικασία αυτή εξασφαλίζει ότι το περιβάλλον παραμένει νομικά θωρακισμένο απέναντι σε ρυθμιστικές αρχές που επιβάλλουν αυστηρότερους νόμους ελέγχου ηλικίας στο διαδίκτυο.

Η στρατηγική στροφή της OpenAI

Η απόφαση για τη δημιουργία αυτού του διακόπτη δεν προκύπτει εν κενώ. Η OpenAI, υπό την καθοδήγηση του Sam Altman, είχε αφήσει από καιρό υπόνοιες ότι τα μοντέλα τεχνητής νοημοσύνης πρέπει να προσαρμόζονται στις προσωπικές προτιμήσεις του χρήστη, υπό την προϋπόθεση ότι δεν παραβιάζουν τον νόμο. Ο διάλογος γύρω από την αποκαλούμενη "πορνοποίηση" (pornification) των AI chatbots είναι τεράστιος.

Μέχρι πρόσφατα, ανταγωνιστικά ανοιχτά μοντέλα (όπως κάποιες αφιλτράριστες εκδόσεις του Llama της Meta στο Hugging Face) ή πλατφόρμες όπως το Character.AI είχαν μονοπωλήσει το ενδιαφέρον όσων αναζητούσαν roleplay και συζητήσεις χωρίς ηθικούς περιορισμούς. Η ενσωμάτωση του "Naughty chats" δείχνει την πρόθεση της OpenAI να διατηρήσει αυτό το μερίδιο χρηστών εντός του δικού της οικοσυστήματος.

Είναι σημαντικό να διαχωριστεί η "πικάντικη" γλώσσα από το απολύτως παράνομο περιεχόμενο. Ακόμα και με τον διακόπτη ενεργό, τα βασικά όρια που αφορούν την υποκίνηση σε βία, το CSAM (υλικό σεξουαλικής κακοποίησης παιδιών) και τις βαθιές παραβιάσεις δικαιωμάτων θα παραμένουν αυστηρά κωδικοποιημένα (hardcoded) στο δίκτυο ασφαλείας του μοντέλου. Το "Naughty chats" αφορά κυρίως την ελευθερία έκφρασης, τη συγγραφή ερωτικής λογοτεχνίας, το αφιλτράριστο χιούμορ και το ελεύθερο roleplay.

Τι σημαίνει αυτό για τους χρήστες στην Ελλάδα και την ΕΕ

Η εφαρμογή ενός τέτοιου συστήματος στην ευρωπαϊκή αγορά αναμένεται να είναι περίπλοκη. Ο νόμος AI Act της Ευρωπαϊκής Ένωσης, σε συνδυασμό με τον GDPR (Γενικός Κανονισμός για την Προστασία Δεδομένων), θέτει εξαιρετικά υψηλά εμπόδια στον τρόπο με τον οποίο οι εταιρείες συλλέγουν και επεξεργάζονται βιομετρικά δεδομένα (όπως οι selfies για το Persona) και τα προσωπικά έγγραφα ταυτοποίησης.

Για τον Έλληνα χρήστη, αυτό σημαίνει ότι:

- Καθυστέρηση Διάθεσης: Είναι εξαιρετικά πιθανό η λειτουργία "Naughty chats" να λανσαριστεί αρχικά μόνο στις ΗΠΑ, με την Ευρώπη να ακολουθεί μήνες αργότερα, μέχρι η OpenAI να διασφαλίσει την πλήρη νομική συμμόρφωση με τον GDPR.

- Προβληματισμοί Ιδιωτικότητας: Η παραχώρηση ταυτότητας και φωτογραφίας σε μια πλατφόρμα AI για πρόσβαση σε συνομιλίες ενηλίκων εγείρει σοβαρά ζητήματα απορρήτου. Παρότι η υπηρεσία Persona διαγράφει συνήθως τα δεδομένα μετά την επαλήθευση, η διστακτικότητα των Ευρωπαίων καταναλωτών θεωρείται δεδομένη.

- Μοντέλο Συνδρομής: Παρότι ο κώδικας δεν το διευκρινίζει, τέτοιου είδους υπολογιστικά ακριβές λειτουργίες (ειδικά αν απαιτούν αλλαγές στο context window ή χρήση ειδικά εκπαιδευμένων παραμέτρων) συνήθως περιορίζονται στα συνδρομητικά πακέτα (ChatGPT Plus ή στο φημολογούμενο ενδιάμεσο πλάνο των 100 δολαρίων).

Είναι προφανές ότι οι γλωσσικές μηχανές ωριμάζουν και προσπαθούν να προσομοιώσουν ολόκληρο το φάσμα της ανθρώπινης επικοινωνίας. Η αποστείρωση των απαντήσεων εξυπηρετούσε τον σκοπό της ασφαλούς εξοικείωσης του κοινού με την τεχνολογία. Τώρα, περνάμε στη φάση της παραμετροποίησης, όπου ο τελικός χρήστης επιλέγει τα όρια του δικού του ψηφιακού βοηθού.

Η άποψη του Techgear

Η ανακάλυψη του διακόπτη "Naughty chats" στον κώδικα του ChatGPT δεν αποτελεί έκπληξη. Η υπερβολική "αποστείρωση" των LLMs οδηγεί συχνά σε μειωμένη δημιουργικότητα και εκνευρισμό των χρηστών, ακόμα και για εντελώς αθώα prompts που "χτυπάνε" ψευδώς στα φίλτρα.

Το γεγονός ότι η OpenAI μεταφέρει την ευθύνη της επιλογής στον χρήστη, συνδυάζοντάς την με αυστηρή ταυτοποίηση μέσω KYC πλατφορμών, είναι η πιο τεχνοκρατικά σωστή προσέγγιση.

Το μεγάλο στοίχημα, ωστόσο, ειδικά για εμάς στην Ευρώπη, παραμένει ο GDPR. Η απαίτηση για σκανάρισμα ταυτότητας και λήψη selfie προκειμένου να ανταλλάξει κάποιος μηνύματα roleplay με ένα AI, δημιουργεί έναν "εφιάλτη" διαχείρισης προσωπικών δεδομένων.

Θα έχει εξαιρετικό ενδιαφέρον να δούμε πώς θα αντιδράσουν οι ρυθμιστικές αρχές της ΕΕ όταν το χαρακτηριστικό βγει από τον κώδικα και μπει στην παραγωγή.