Σύνοψη

- Μελέτη της Ακτινολογικής Εταιρείας της Βόρειας Αμερικής (RSNA) δείχνει ότι εξειδικευμένοι ιατροί εντόπισαν αυθόρμητα μόλις το 41% των deepfake ακτινογραφιών.

- Ακόμα και μετά από σχετική προειδοποίηση για την ύπαρξη τεχνητών εικόνων, το μέσο ποσοστό επιτυχούς αναγνώρισης έφτασε μόνο το 75%.

- Κορυφαία LLMs (GPT-4o, GPT-5, Gemini 2.5 Pro, Llama 4 Maverick) δυσκολεύονται ομοίως να αναγνωρίσουν τις πλαστές ιατρικές εικόνες, με κανένα μοντέλο να μην επιτυγχάνει απόλυτο ποσοστό εντοπισμού.

- Η παραγωγή ρεαλιστικών deepfake μέσω απλών εντολών (prompts) κειμένου μειώνει κατακόρυφα το τεχνικό εμπόδιο για την παραγωγή τους.

- Οι τεχνητές ακτινογραφίες εγκυμονούν τεράστιους κινδύνους για ασφαλιστικές απάτες, νομικές διεκδικήσεις και παραβίαση ή «μόλυνση» ηλεκτρονικών ιατρικών αρχείων.

- Ελάχιστα οπτικά σημάδια, όπως ο αφύσικα λείος φλοιός των οστών και η υπερβολική συμμετρία, αποτελούν τα μοναδικά στοιχεία για τον εντοπισμό τους.

Η ραγδαία εξέλιξη των πολυτροπικών μεγάλων γλωσσικών μοντέλων (Multimodal LLMs) έχει επιφέρει ριζικές αλλαγές στον τρόπο παραγωγής και διαχείρισης συνθετικού περιεχομένου.

Ωστόσο, μια νέα έρευνα της Ακτινολογικής Εταιρείας της Βόρειας Αμερικής (RSNA), αναδεικνύει μια εξαιρετικά ανησυχητική διάσταση: τα ιατρικά deepfakes είναι πλέον τόσο προηγμένα που ξεγελούν ταυτόχρονα τους πλέον καταρτισμένους επιστήμονες υγείας και τα ίδια τα συστήματα τεχνητής νοημοσύνης που τα δημιουργούν.

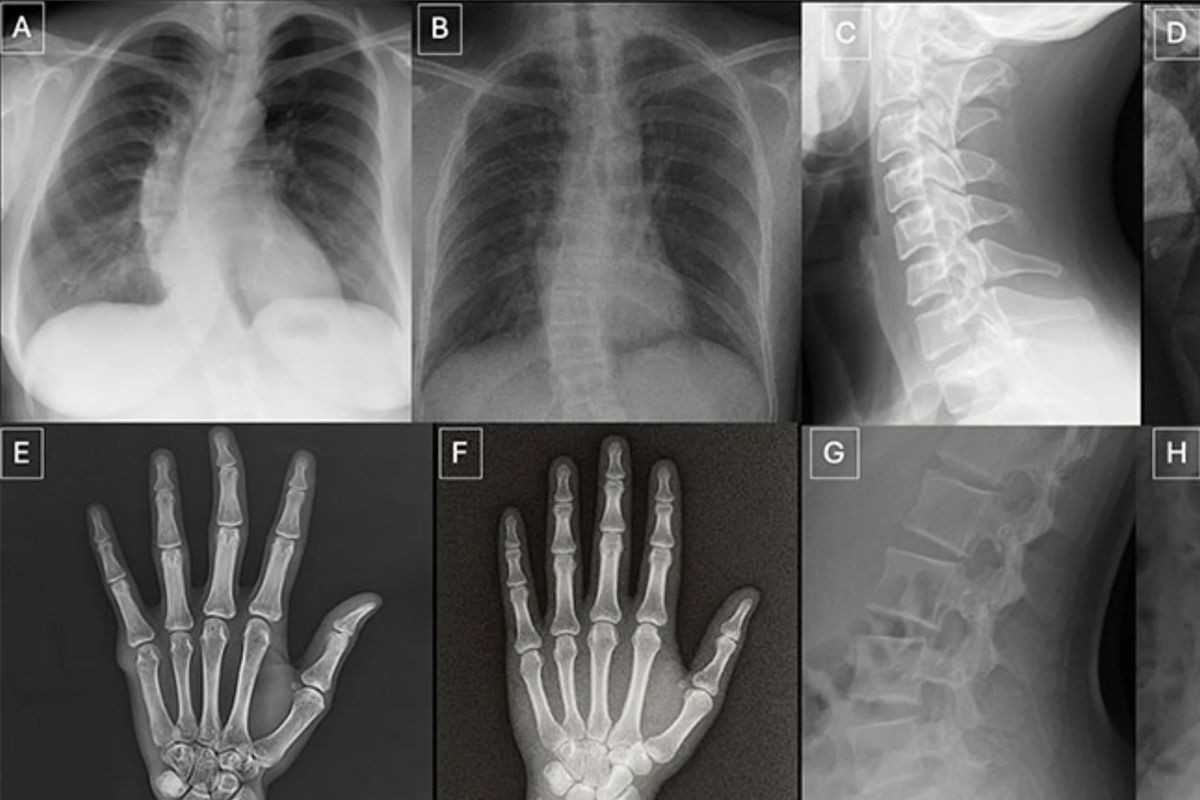

Η μελέτη, με επικεφαλής τον Δρ. Mickael Tordjman από την Ιατρική Σχολή Icahn του Mount Sinai, καταγράφει την αποτυχία 17 έμπειρων ακτινολόγων από έξι διαφορετικές χώρες να διακρίνουν σταθερά τις αυθεντικές ακτινογραφίες από τις αντίστοιχες που παρήχθησαν μέσω τεχνητής νοημοσύνης. Οι ερευνητές χρησιμοποίησαν ένα σύνολο 264 ακτινογραφιών, εκ των οποίων οι μισές ήταν πραγματικές και οι υπόλοιπες δημιουργήθηκαν μέσω του ChatGPT-4o (της OpenAI) και του εξειδικευμένου μοντέλου RoentGen.

Η μεθοδολογία της έρευνας χωρίστηκε σε διακριτές φάσεις για να μετρηθεί η αντικειμενική ικανότητα των ιατρών. Στην πρώτη φάση, οι ακτινολόγοι εξέτασαν τις εικόνες χωρίς να γνωρίζουν τον πραγματικό σκοπό της μελέτης. Όταν κλήθηκαν να αξιολογήσουν την τεχνική ποιότητα και να εντοπίσουν τυχόν ανωμαλίες, μόλις το 41% αντιλήφθηκε αυθόρμητα την παρουσία τεχνητών εικόνων. Το συγκεκριμένο εύρημα καταδεικνύει την επικίνδυνη αληθοφάνεια των παραγόμενων αρχείων.

Στη δεύτερη φάση, αφού οι ιατροί ενημερώθηκαν ότι το δείγμα περιείχε συνθετικές ακτινογραφίες, η μέση ακρίβεια διάκρισης αυξήθηκε στο 75%. Παρότι η βελτίωση είναι εμφανής, το ποσοστό αποτυχίας του 25% παραμένει απαγορευτικό για κλινικά και νομικά δεδομένα. Η ατομική απόδοση των ιατρών παρουσίασε μεγάλες διακυμάνσεις, κυμαινόμενη από 58% έως 92%. Ενδιαφέρον παρουσιάζει το γεγονός ότι η ηλικία και τα έτη προϋπηρεσίας (τα οποία έφταναν έως και τα 40 έτη) δεν αποτέλεσαν καθοριστικό παράγοντα επιτυχίας, αν και οι ακτινολόγοι με εξειδίκευση στο μυοσκελετικό σύστημα επέδειξαν ελαφρώς υψηλότερα ποσοστά αναγνώρισης.

Η αδυναμία εντοπισμού δεν περιορίζεται στον ανθρώπινο παράγοντα. Η ερευνητική ομάδα υπέβαλε τις ίδιες εικόνες σε έλεγχο από τέσσερα κορυφαία πολυτροπικά μοντέλα: το GPT-4o, το GPT-5, το Gemini 2.5 Pro της Google και το Llama 4 Maverick της Meta. Τα αποτελέσματα επιβεβαίωσαν τα όρια της σημερινής τεχνολογίας. Το GPT-4o, το οποίο χρησιμοποιήθηκε για τη δημιουργία μεγάλου μέρους του πλαστού υλικού, κατέγραψε το υψηλότερο ποσοστό επιτυχίας με 85%. Αντίθετα, τα μοντέλα της Google και της Meta παρουσίασαν ποσοστά ακρίβειας που δεν ξεπέρασαν το 56% και το 59% αντίστοιχα, επιδόσεις που ελάχιστα διαφέρουν από την τυχαία επιλογή. Το γεγονός ότι ένα μοντέλο αποτυγχάνει κατά 15% να αναγνωρίσει τα δικά του δημιουργήματα ακυρώνει την προσδοκία αυτορρύθμισης της τεχνητής νοημοσύνης μέσω αλγοριθμικού ελέγχου.

Σε αντίθεση με τα παλαιότερα Generative Adversarial Networks (GANs) που απαιτούσαν βαθιά προγραμματιστική γνώση και εξειδικευμένα σύνολα δεδομένων για να παραγάγουν πειστικές ιατρικές εικόνες, τα σημερινά μοντέλα λειτουργούν με φυσική γλώσσα. Οποιοσδήποτε χρήστης μπορεί, μέσω μιας απλής περιγραφικής εντολής (π.χ., "Δημιούργησε μια ακτινογραφία θώρακος που να δείχνει πνευμονία σε ενήλικα"), να λάβει μια ανατομικά ορθή εικόνα. Αυτός ο εκδημοκρατισμός των εργαλείων παραγωγής συνθετικού περιεχομένου έχει ήδη σημάνει συναγερμό για συγκεκριμένους συστημικούς κινδύνους.

Η δημιουργία ανύπαρκτων καταγμάτων ή αλλοιώσεων επιτρέπει τη θεμελίωση ψευδών ιατρικών γνωματεύσεων, γεγονός που ανοίγει τον δρόμο για εξόφθαλμες απάτες κατά ασφαλιστικών εταιρειών ή παραπλανητικές νομικές διεκδικήσεις για σωματικές βλάβες. Επιπλέον, υπάρχει ο κίνδυνος της «δηλητηρίασης δεδομένων». Εάν αυτές οι ψευδείς ακτινογραφίες εισχωρήσουν στα τεράστια αποθετήρια ιατρικών δεδομένων, θα καταστρέψουν την αξιοπιστία των μελλοντικών αλγορίθμων μηχανικής μάθησης που εκπαιδεύονται αποκλειστικά σε αυτά για διαγνωστικούς σκοπούς.

Οι ειδικοί επισημαίνουν ότι ορισμένα τεχνικά χαρακτηριστικά προδίδουν τη συνθετική φύση αυτών των εικόνων, αν και απαιτείται εκπαιδευμένο μάτι. Οι πλαστές ακτινογραφίες συχνά παρουσιάζουν υπερβολικά λείες οστικές επιφάνειες, αφύσικη και απόλυτη συμμετρία, ατελή διακοπή του φλοιού στα κατάγματα και ενιαία μοτίβα θορύβου που δεν συναντώνται στους παραδοσιακούς αισθητήρες των ακτινολογικών μηχανημάτων.

Με τη ματιά του Techgear

Η μελέτη του Mount Sinai αποδεικνύει περίτρανα ότι έχουμε ξεπεράσει το σημείο όπου η ανθρώπινη όραση –ακόμη και η πλέον εξειδικευμένη– αποτελεί το ύστατο κριτήριο αλήθειας. Η επικέντρωση στον εντοπισμό μέσω «οπτικών ατελειών» είναι μια μάχη καταδικασμένη να χαθεί, καθώς η επόμενη έκδοση των πολυτροπικών μοντέλων θα εξαλείψει και αυτές τις ελάχιστες ατέλειες. Η λύση δεν βρίσκεται στην εκπαίδευση των ιατρών να γίνουν "ανακριτές εικόνων", αλλά στην αρχιτεκτονική του ίδιου του hardware.

Απαιτείται η καθολική υιοθέτηση συστημάτων υδατογράφησης (όπως το SynthID) ή τεχνολογιών C2PA (Coalition for Content Provenance and Authenticity) απευθείας εντός των ιατρικών μηχανημάτων (CT scanners, X-ray machines). Κάθε αυθεντική εικόνα πρέπει να φέρει αμετάβλητη κρυπτογραφική υπογραφή από τη στιγμή της λήψης της, διασφαλίζοντας την ιχνηλασιμότητα στο ψηφιακό οικοσύστημα του 2026.