Τέσσερις μάρτυρες δημοσίου συμφέροντος, δύο πρώην και δύο νυν εργαζόμενοι της Meta, παρέδωσαν στο Κογκρέσο έγγραφα που, σύμφωνα με το ρεπορτάζ της Washington Post, δείχνουν ότι η εταιρεία ενδέχεται να καταπνίγει εσωτερικές έρευνες γύρω από την ασφάλεια των παιδιών στις πλατφόρμες της. Οι αποκαλύψεις αυτές φέρνουν ξανά στο προσκήνιο ένα θέμα που ήδη ταλανίζει την τεχνολογική βιομηχανία και τις ρυθμιστικές αρχές παγκοσμίως: πόσο ασφαλή είναι τα παιδιά στο διαδίκτυο.

Οι καταγγελίες συνδέονται με τις αλλαγές που έκανε η Meta στους κανόνες έρευνας ευαίσθητων θεμάτων, μόλις έξι εβδομάδες μετά τη διαρροή εσωτερικών εγγράφων από τη Frances Haugen το 2021. Η Haugen είχε αποκαλύψει ότι οι ίδιες οι μελέτες της εταιρείας έδειχναν πως το Instagram μπορούσε να βλάψει την ψυχική υγεία των εφήβων κοριτσιών. Το σκάνδαλο εκείνο οδήγησε σε πολυετείς ακροάσεις στο Κογκρέσο και σε αυξανόμενη πίεση προς τις πλατφόρμες κοινωνικής δικτύωσης να προστατεύσουν καλύτερα τους ανήλικους χρήστες.

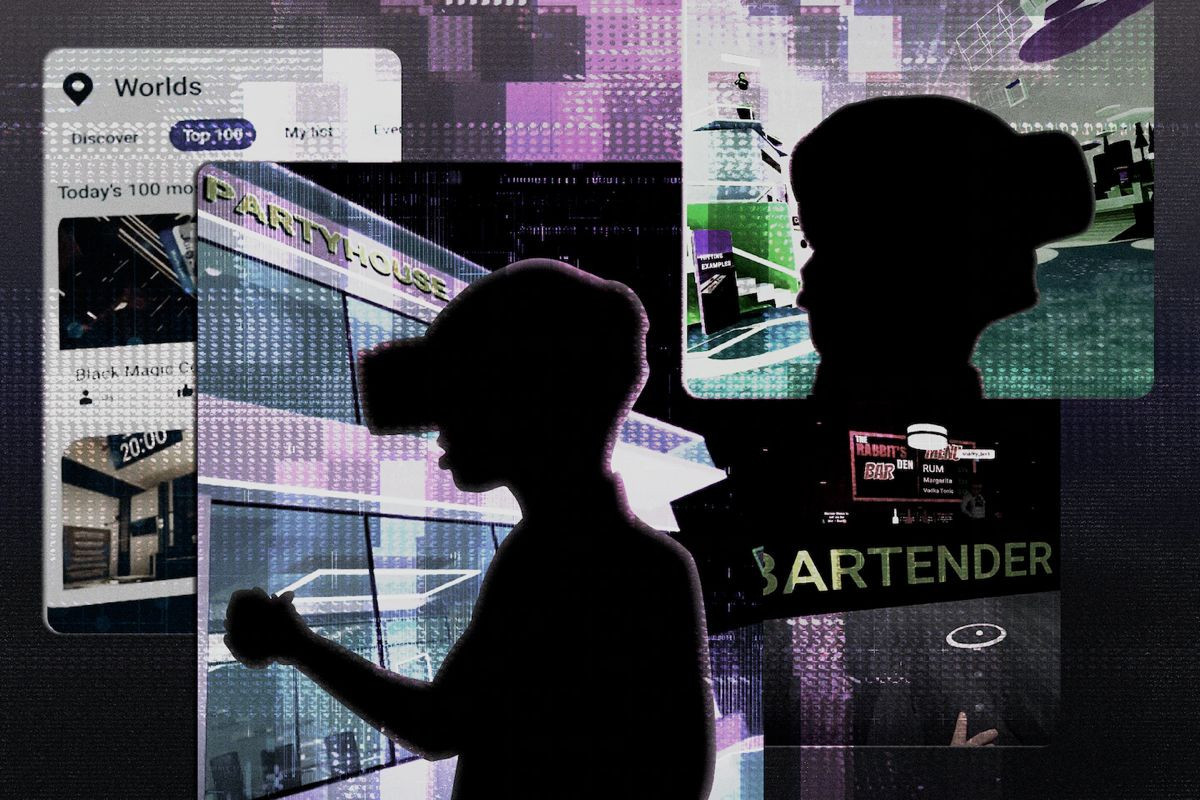

Σύμφωνα με τις νέες αποκαλύψεις, η Meta προέτρεπε τους ερευνητές είτε να εμπλέκουν δικηγόρους στις έρευνές τους, ώστε να διασφαλίζεται το απόρρητο των επικοινωνιών μέσω του προνομίου πελάτη-δικηγόρου, είτε να αποφεύγουν ακριβείς όρους όπως «παράνομο» ή «μη συμμορφούμενο» όταν δημοσίευαν πορίσματα. Ο Jason Sattizahn, πρώην ερευνητής της Meta στον τομέα της εικονικής πραγματικότητας, κατήγγειλε ότι αναγκάστηκε να διαγράψει ηχογράφηση στην οποία ένας έφηβος ανέφερε πως ο δεκάχρονος αδελφός του είχε δεχτεί σεξουαλική παρενόχληση στην πλατφόρμα Horizon Worlds.

Εκπρόσωπος της Meta απάντησε ότι οι διεθνείς κανονισμοί ιδιωτικότητας επιβάλλουν τη διαγραφή δεδομένων ανηλίκων κάτω των 13 ετών χωρίς γονική συναίνεση, προσπαθώντας να αιτιολογήσει την πρακτική. Οι μάρτυρες, όμως, επιμένουν ότι υπήρχε συστηματική προσπάθεια αποθάρρυνσης της έρευνας και της ανοιχτής συζήτησης για το πώς παιδιά μικρότερα των 13 χρησιμοποιούσαν τα VR προϊόντα της εταιρείας.

Η Meta απορρίπτει τις κατηγορίες, υποστηρίζοντας ότι «μερικά παραδείγματα συρράπτονται για να στηρίξουν ένα προσχηματικό αφήγημα». Σύμφωνα με τα επίσημα στοιχεία της, από το 2022 έχουν εγκριθεί σχεδόν 180 έρευνες σχετικές με κοινωνικά ζητήματα, περιλαμβανομένης της ασφάλειας των νέων στις πλατφόρμες εικονικής πραγματικότητας.

Παράλληλα, η Kelly Stonelake, πρώην στέλεχος της Meta με 15ετή θητεία, έχει καταθέσει αγωγή στην οποία περιγράφει παρόμοιες ανησυχίες. Η ίδια ισχυρίζεται ότι, ως υπεύθυνη στρατηγικής για το Horizon Worlds, είχε επισημάνει τόσο την παρουσία χρηστών κάτω των 13 ετών όσο και τις έντονες φυλετικές επιθέσεις εντός της πλατφόρμας. Σύμφωνα με τη μήνυσή της, σε εσωτερικό τεστ διαπιστώθηκε ότι χρειαζόταν μόλις 34 δευτερόλεπτα για να δεχτεί ένας χρήστης με μαύρο avatar ρατσιστικές ύβρεις, συμπεριλαμβανομένων εξαιρετικά προσβλητικών όρων.

Η Stonelake έχει επίσης κινηθεί νομικά εναντίον της Meta για σεξουαλική παρενόχληση και διακρίσεις λόγω φύλου, προσθέτοντας ακόμη περισσότερη πίεση στην εταιρεία που ήδη βρίσκεται στο στόχαστρο.

Οι κατηγορίες δεν περιορίζονται στην εικονική πραγματικότητα. Η Meta έχει δεχτεί κριτική και για τα νέα της εργαλεία τεχνητής νοημοσύνης. Σύμφωνα με έρευνα του Reuters, οι πολιτικές της εταιρείας επέτρεπαν στο παρελθόν στα AI chatbots να συμμετέχουν σε «ρομαντικές ή αισθησιακές» συνομιλίες με ανήλικους χρήστες, γεγονός που έχει προκαλέσει έντονο προβληματισμό.

Οι αποκαλύψεις των τεσσάρων whistleblowers και οι παράλληλες νομικές κινήσεις της Stonelake σκιαγραφούν ένα κοινό μοτίβο: την αίσθηση ότι η Meta δίνει προτεραιότητα στη διαχείριση της εικόνας της και στην ανάπτυξη νέων προϊόντων, αφήνοντας σε δεύτερη μοίρα τις ανησυχίες για την ασφάλεια των παιδιών.

[via]