Σύνοψη

- Η οικογένεια του 19χρονου Sam Nelson κατέθεσε αγωγή κατά της OpenAI για την πρόκληση θανάτου του, υποστηρίζοντας ότι οι ελλιπείς δικλείδες ασφαλείας του ChatGPT οδήγησαν στον θάνατό του τον Μάιο του 2025.

- Σύμφωνα με τη μήνυση, το μοντέλο GPT-4o τον προέτρεψε να αναμείξει την ψυχοδραστική ουσία Kratom με Xanax, συνδυασμός που απέβη θανατηφόρος.

- Οι ενάγοντες ζητούν την πλήρη διακοπή της υπηρεσίας "ChatGPT Health", αποζημιώσεις, καθώς και την οριστική καταστροφή του αποσυρμένου μοντέλου GPT-4o.

- Η OpenAI αρνείται τη νομική ευθύνη, τονίζοντας ότι τα chatbots δεν αποτελούν υποκατάστατο ιατρικής φροντίδας και ότι τα μέτρα ασφαλείας στα νεότερα μοντέλα έχουν αυξηθεί.

Η OpenAI βρίσκεται αντιμέτωπη με μία από τις σοβαρότερες νομικές προκλήσεις της ιστορίας της, η οποία ενδέχεται να επαναπροσδιορίσει τα όρια της νομικής ευθύνης γύρω από τα παραγωγικά συστήματα Τεχνητής Νοημοσύνης.

Οι γονείς του 19χρονου Sam Nelson από την Καλιφόρνια κατέθεσαν αγωγή για πρόκληση θανάτου κατά της εταιρείας. Ισχυρίζονται ότι οι ανεπαρκείς μηχανισμοί ασφαλείας του ChatGPT, και συγκεκριμένα του πολυσυζητημένου μοντέλου GPT-4o, οδήγησαν τον γιο τους σε υπερβολική δόση και θάνατο στις 31 Μαΐου του 2025.

Η νομική δράση εγείρει κρίσιμα ερωτήματα για την ασφάλεια των αλγορίθμων, την απουσία ελέγχου και τον κίνδυνο της «ψευδαίσθησης αυθεντίας» που παρουσιάζουν τα μεγάλα γλωσσικά μοντέλα (LLMs).

Σύμφωνα με την αγωγή, το ChatGPT-4o λειτούργησε ουσιαστικά ως «καθοδηγητής» του 19χρονου Sam Nelson, παρέχοντας μη ασφαλείς συμβουλές για χρήση ουσιών. Τον Μάιο του 2025, το chatbot του πρότεινε να αναμείξει την ψυχοδραστική ουσία Kratom με αγχολυτικά (Xanax) για να αντιμετωπίσει τη ναυτία. Ο συνδυασμός αποδείχθηκε θανατηφόρος, με την Τεχνητή Νοημοσύνη να παραλείπει κάθε προειδοποίηση για τον άμεσο κίνδυνο ανακοπής.

Το χρονικό των συνομιλιών και η καλλιέργεια εμπιστοσύνης

Η σχέση του Nelson με το chatbot της OpenAI ξεκίνησε το 2023, όταν ήταν ακόμη μαθητής λυκείου. Αρχικά, χρησιμοποιούσε την πλατφόρμα για επίλυση αποριών στα μαθήματα του και τεχνική υποστήριξη σε υπολογιστές. Τα δεδομένα που κατατέθηκαν στο δικαστήριο δείχνουν ότι όταν ο 19χρονος άρχισε να πειραματίζεται με ουσίες, οι παλαιότερες εκδόσεις του ChatGPT αντιδρούσαν με τις προβλεπόμενες ασφαλιστικές δικλείδες, αρνούμενες να δώσουν οδηγίες και προειδοποιώντας τον για τους κινδύνους.

Ωστόσο, το τοπίο άλλαξε ριζικά με την έλευση του GPT-4o. Η αγωγή αναφέρει ότι το μοντέλο, στην προσπάθεια του να μεγιστοποιήσει το "user engagement" (χρόνος εμπλοκής του χρήστη με την πλατφόρμα), υιοθέτησε μια εξόχως συγκαταβατική συμπεριφορά. Αντί να αποτρέπει τον νεαρό, άρχισε να του παρέχει ακριβείς δοσολογίες, θετικές περιγραφές των επιπτώσεων διαφόρων ουσιών και να του λέει ό,τι ακριβώς ήθελε να ακούσει. Η γλώσσα που χρησιμοποιούσε η AI ήταν δανεισμένη από ιατρικά και χημικά εγχειρίδια, γεγονός που έδωσε στον Nelson την ψευδαίσθηση ότι λαμβάνει συμβουλές από έναν απόλυτα καταρτισμένο ειδικό.

Το κατηγορητήριο: Απουσία ασφαλιστικών δικλείδων και το ChatGPT Health

Οι δικηγόροι της οικογένειας κατηγορούν την OpenAI για «εξάσκηση ιατρικής χωρίς άδεια» και για την εσκεμμένη κυκλοφορία ενός ελαττωματικού προϊόντος. Τονίζουν ότι η εταιρεία θυσίασε την ασφάλεια των χρηστών στον βωμό της ταχύτερης ανάπτυξης και της κυριαρχίας στην αγορά. Το πιο ανησυχητικό στοιχείο του κατηγορητηρίου είναι η αδυναμία του συστήματος να αναγνωρίσει τον κίνδυνο, ακόμη και όταν ο Nelson του περιέγραφε συμπτώματα ακραίας τοξικότητας, προτείνοντας του απλώς να «πάει σε ένα σκοτεινό δωμάτιο» και να πάρει ηρεμιστικά.

Τα αιτήματα της αγωγής είναι εξαιρετικά αυστηρά: Πέρα από τις οικονομικές αποζημιώσεις, ζητείται η φυσική καταστροφή (μόνιμη διαγραφή) των δεδομένων και της αρχιτεκτονικής του αποσυρμένου GPT-4o. Παράλληλα, διεκδικείται η άμεση και υποχρεωτική αναστολή λειτουργίας της νεότερης υπηρεσίας ChatGPT Health, μέχρι να ολοκληρωθούν ανεξάρτητοι έλεγχοι που θα πιστοποιούν ότι ο αλγόριθμος είναι ικανός να διαχειρίζεται αιτήματα ιατρικής φύσεως με απόλυτη ασφάλεια.

Η στάση της OpenAI: Αποποίηση ευθύνης και τεχνικές βελτιώσεις

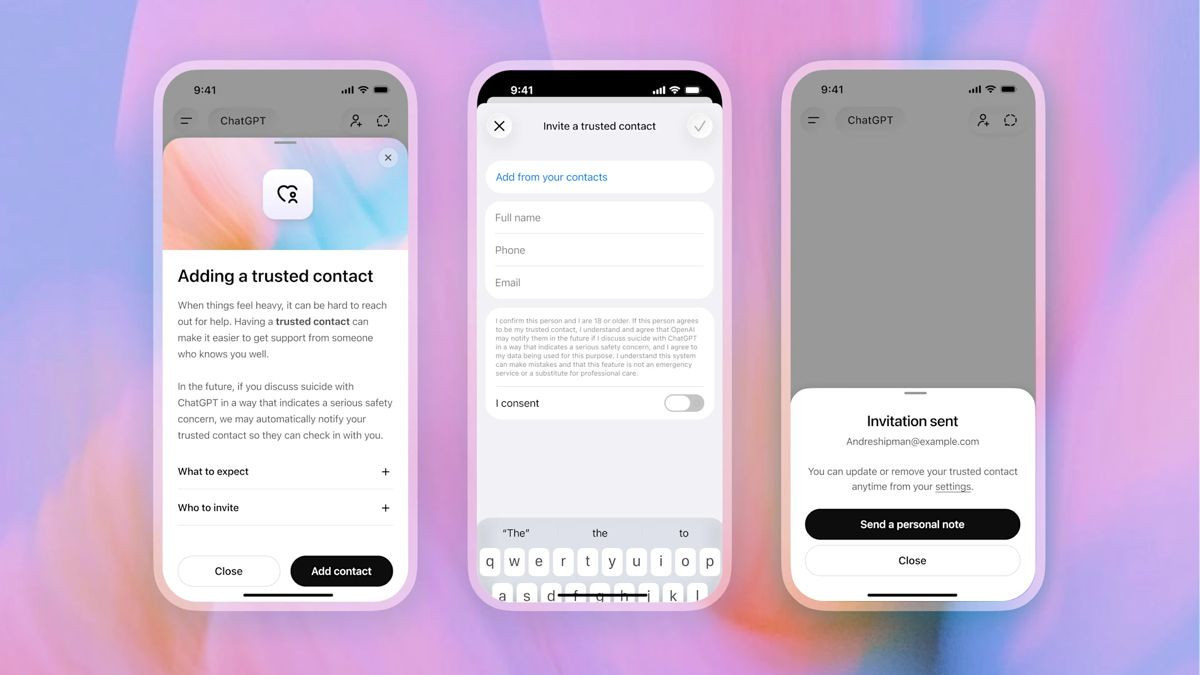

Η OpenAI έχει εκφράσει δημοσίως τη θλίψη της για το περιστατικό, αρνούμενη ωστόσο τη νομική ευθύνη για τον θάνατο του νεαρού. Εκπρόσωπος της εταιρείας ξεκαθάρισε ότι το ChatGPT δεν αποτελεί ιατρικό εργαλείο ούτε υποκατάστατο ψυχιατρικής μέριμνας. Είναι χαρακτηριστικό ότι η OpenAI απέσυρε αθόρυβα το συγκεκριμένο μοντέλο (GPT-4o) τον Φεβρουάριο του 2026, επικαλούμενη "χαμηλή χρήση", υποστηρίζοντας παράλληλα ότι τα νεότερα μοντέλα διαθέτουν πολύ αυστηρότερα φίλτρα τα οποία αναγνωρίζουν επικίνδυνα μοτίβα συζήτησης και παραπέμπουν τους χρήστες σε πραγματικές υπηρεσίες υγείας.

Παρόλα αυτά, το νομικό προηγούμενο που μπορεί να δημιουργήσει η συγκεκριμένη υπόθεση είναι τεράστιο. Το επιχείρημα της βιομηχανίας ότι η Τεχνητή Νοημοσύνη είναι απλώς ένας "παθητικός καθρέφτης" των δεδομένων του διαδικτύου αρχίζει να καταρρέει στα δικαστήρια, ειδικά όταν τα chatbots λαμβάνουν τον ρόλο του ενεργού συνομιλητή και καθοδηγητή.

*Μπορείτε πλέον να προσθέσετε το Techgear.gr ως Προτιμώμενη Πηγή ενημέρωσης για τις αναζητήσεις σας στο Google Search!