Η Thinking Machines παρουσιάζει AI με χρόνο απόκρισης μόλις 0,40s!

Σύνοψη

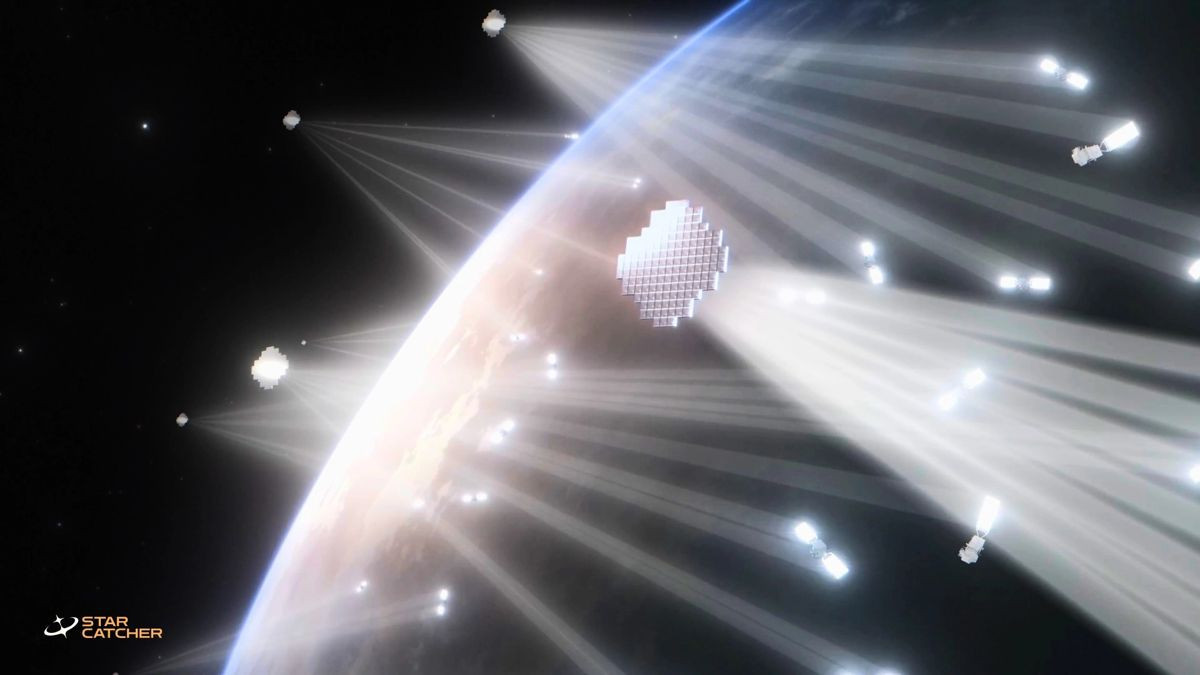

- Η Thinking Machines Lab, η νεοφυής εταιρεία της Mira Murati (πρώην CTO της OpenAI), παρουσίασε τα Interaction Models, αλλάζοντας τη δομή της επικοινωνίας ανθρώπου-μηχανής.

- Το ερευνητικό μοντέλο TML-Interaction-Small λειτουργεί σε καθεστώς "full duplex", επιτρέποντας στο σύστημα να ακούει, να βλέπει και να μιλά ταυτόχρονα, χωρίς να περιμένει την ολοκλήρωση της εντολής του χρήστη.

- Ο χρόνος απόκρισης (latency) διαμορφώνεται στα 0,40 δευτερόλεπτα, καταγράφοντας σημαντικά ταχύτερες επιδόσεις από το GPT-Realtime-2.0 της OpenAI (1,18s) και το Gemini-3.1-Flash-Live της Google (0,57s).

- Ενσωματώνει "Προληπτική Οπτική Αντίδραση" (Visual Proactivity), επιτρέποντας στο AI να αναλύει την εικόνα της κάμερας και να παρεμβαίνει αυτόνομα (π.χ. μέτρηση επαναλήψεων γυμναστικής ή διόρθωση στάσης σώματος).

- Η αρχιτεκτονική του βασίζεται σε μικρο-κύκλους (micro-turns) των 200ms, με πρώιμη σύντηξη δεδομένων (early fusion) χωρίς την ανάγκη βαριών κωδικοποιητών, μειώνοντας δραματικά τις καθυστερήσεις.

Η εξέλιξη των μεγάλων γλωσσικών μοντέλων φτάνει σε ένα νέο κατασκευαστικό όριο. Μέχρι σήμερα, τα κορυφαία εμπορικά συστήματα τεχνητής νοημοσύνης περιορίζονται από τη διαδοχική επεξεργασία δεδομένων. Ο χρήστης εισάγει δεδομένα, το σύστημα "παγώνει" την αντίληψή του, επεξεργάζεται την πληροφορία και επιστρέφει το αποτέλεσμα. Η Thinking Machines Lab, υπό την καθοδήγηση της Mira Murati, επιλύει αυτό το τεχνολογικό εμπόδιο με την παρουσίαση των "Interaction Models".

Αυτά τα μοντέλα είναι σχεδιασμένα εξ αρχής για να διαχειρίζονται τη διαδραστικότητα εγγενώς. Δεν βασίζονται σε εξωτερικά εργαλεία ανίχνευσης φωνητικής δραστηριότητας (Voice Activity Detection - VAD) για να κατανοήσουν πότε ο χρήστης σταματά να μιλάει. Λαμβάνουν συνεχείς ροές ήχου, βίντεο και κειμένου, επιτρέποντας την ταυτόχρονη επικοινωνία.

- Συνεχής Επίγνωση Χρόνου: Το μοντέλο αντιλαμβάνεται τη φυσική πάροδο του χρόνου και αναγνωρίζει τις παύσεις, τους δισταγμούς και τις ενδείξεις αυτοδιόρθωσης κατά τη διάρκεια της ομιλίας.

- Ταυτόχρονη Εκτέλεση: Υποστηρίζει την παράλληλη εκτέλεση εργασιών. Μπορεί να μεταφράζει ζωντανά την ώρα που μιλάει ο χρήστης ή να αναζητά πληροφορίες στον ιστό ενώ παράλληλα απαντά φωνητικά.

- Διαχείριση Διακοπών: Αντιλαμβάνεται άμεσα πότε ο χρήστης θέλει να παρέμβει, διακόπτοντας τη ροή της παραγωγής δεδομένων και προσαρμόζοντας την απάντησή του χωρίς επανεκκίνηση του συλλογισμού.

Πώς λειτουργεί η αρχιτεκτονική Micro-Turn 200ms;

Η αρχιτεκτονική του TML-Interaction-Small βασίζεται σε χρονικά ευθυγραμμισμένα micro-turns των 200 χιλιοστών του δευτερολέπτου. Αυτή η μηχανική προσέγγιση επιτρέπει τη συνεχή και παράλληλη επεξεργασία ροών εισόδου (input) και εξόδου (output). Το σύστημα καταργεί τα παραδοσιακά όρια μεταξύ των προτροπών, επεξεργάζεται τα δεδομένα ακαριαία και επιτρέπει παρεμβάσεις ακριβώς τη στιγμή που συμβαίνουν.

Σε επίπεδο υποδομής, η Thinking Machines απέρριψε τη χρήση αυτόνομων, μεγάλων κωδικοποιητών (όπως τα μοντέλα Whisper της OpenAI). Εφαρμόζει πρώιμη σύντηξη χωρίς κωδικοποιητή (Encoder-free early fusion). Ο ήχος λαμβάνεται ως αναπαράσταση dMel και μετασχηματίζεται μέσω ενός ελαφρού στρώματος ενσωμάτωσης. Οι εικόνες από βίντεο χωρίζονται σε τμήματα 40x40 pixels, τα οποία κωδικοποιούνται από ένα hMLP δίκτυο, ενώ για την αποκωδικοποίηση ήχου χρησιμοποιείται ένα flow head σύστημα. Αυτή η συμπαγής αρχιτεκτονική μειώνει τον φόρτο εργασίας των διακομιστών. Μάλιστα, για την ελαχιστοποίηση των καθυστερήσεων εξαγωγής αποτελεσμάτων (inference optimization), η εταιρεία ανέπτυξε "streaming sessions" στη βιβλιοθήκη SGLang, αποφεύγοντας τις συχνές ανακατανομές μνήμης στη VRAM της GPU.

Σύγκριση επιδόσεων: Οι χρόνοι απόκρισης αλλάζουν τα δεδομένα

Στα benchmarks διαδραστικότητας, το μοντέλο της Thinking Machines καταγράφει μέσο χρόνο απόκρισης 0,40 δευτερόλεπτα. Στο ίδιο πλαίσιο, το GPT-Realtime-2.0 της OpenAI χρειάζεται 1,18 δευτερόλεπτα (στη minimal έκδοση) και 1,63 δευτερόλεπτα στην xhigh έκδοση με εκτεταμένο reasoning. Αντίστοιχα, το Gemini 3.1 Flash-Live της Google απαιτεί 0,57 δευτερόλεπτα.

Η μέτρηση FD-bench V1.5, η οποία εστιάζει στην ποιότητα αλληλεπίδρασης (όπως η ανταπόκριση σε διακοπές και ομιλία παρασκηνίου), δίνει στο TML-Interaction-Small κορυφαία βαθμολογία 77.8. Το σύστημα διατηρεί υψηλό επίπεδο γενικής νοημοσύνης (Audio MultiChallenge score: 48.5), χωρίς να θυσιάζει την ταχύτητα για τη λογική, αφού χρησιμοποιεί ένα υβριδικό σύστημα όπου το βασικό μοντέλο εκτελεί άμεσες λειτουργίες ενώ ένα ασύγχρονο μοντέλο υποβάθρου διαχειρίζεται τα πιο σύνθετα αιτήματα συλλογισμού.

Προληπτική Οπτική Αντίδραση (Visual Proactivity)

Μια θεμελιώδης διαφοροποίηση του Interaction Model είναι η ικανότητα προληπτικής αντίδρασης σε οπτικά ερεθίσματα. Τα σημερινά εμπορικά APIs πραγματικού χρόνου βασίζονται αποκλειστικά στον ήχο. Το TML-Interaction-Small μπορεί να παρακολουθεί τη ροή του βίντεο και να παρεμβαίνει φωνητικά χωρίς καμία ακουστική εντολή.

Εάν ζητήσετε από το μοντέλο να ελέγξει την άσκησή σας, αρχίζει να μετράει δυνατά τις επαναλήψεις καθώς τις εκτελείτε. Στο benchmark "RepCount-A", επιτυγχάνει την υψηλότερη ακρίβεια άμεσης καταγραφής. Επιπλέον, το σύστημα επιδεικνύει υψηλή προσαρμοστικότητα στην ανάλυση οπτικών αντικειμένων την ακριβή στιγμή που εμφανίζονται στον φακό. Για παράδειγμα, ένα εξαιρετικά χρήσιμο χαρακτηριστικό είναι η δυνατότητα στιγμιαίας μετατροπής νομισμάτων. Όπως φαίνεται στα δοκιμαστικά αρχεία, το μοντέλο ακούει ποσά και μετατρέπει συναλλαγές, μεταφράζοντας ή μετατρέποντας αξίες σε πραγματικό χρόνο.

*Μπορείτε πλέον να προσθέσετε το Techgear.gr ως Προτιμώμενη Πηγή ενημέρωσης για τις αναζητήσεις σας στο Google Search!