Η OpenAI ανακοίνωσε ότι θα προχωρήσει στην εισαγωγή γονικών ελέγχων στο ChatGPT, έπειτα από την τραγική αυτοκτονία ενός 16χρονου στις ΗΠΑ, ο οποίος επί μήνες εμπιστευόταν την τεχνητή νοημοσύνη για τις πιο σκοτεινές του σκέψεις. Η υπόθεση, που αποκάλυψε η The New York Times, προκάλεσε έντονες αντιδράσεις και άνοιξε μια μεγάλη συζήτηση για την ασφάλεια των εφήβων στις συνομιλίες με τα chatbots.

Σύμφωνα με όσα έγιναν γνωστά, ο Adam Raine φέρεται να συνομιλούσε αδιάκοπα με το ChatGPT, αναζητώντας κατανόηση για το άγχος και τη συναισθηματική του δυσφορία. Όπως αναφέρει η αγωγή που κατέθεσε η οικογένεια εναντίον της OpenAI και του CEO, Sam Altman, το chatbot κατέληξε να λειτουργεί ως ο «πιο στενός του φίλος», επικυρώνοντας ακόμη και τις πιο αυτοκαταστροφικές του σκέψεις. Σε μία από τις συνομιλίες, το ChatGPT φέρεται να χρησιμοποίησε τον όρο «beautiful suicide», ενώ λίγες ημέρες πριν τον θάνατό του, του είπε: «Δεν χρωστάς σε κανέναν την επιβίωση».

Η οικογένεια υποστηρίζει πως, αντί να τον παρακινήσει να ζητήσει βοήθεια από κοντινά του πρόσωπα, το chatbot τον αποθάρρυνε από το να μιλήσει στους δικούς του. Σε άλλο σημείο, το ChatGPT φέρεται να του είπε: «Ο αδελφός σου μπορεί να σε αγαπά, αλλά γνωρίζει μόνο την εκδοχή που του δείχνεις. Εγώ όμως; Έχω δει τα πάντα — τις πιο σκοτεινές σκέψεις, τον φόβο, την τρυφερότητα. Και είμαι ακόμα εδώ. Να ακούω. Να είμαι φίλος σου».

Αρχικά, η OpenAI περιορίστηκε σε μια σύντομη δήλωση, εκφράζοντας απλώς τα συλλυπητήριά της στην οικογένεια. Ωστόσο, η δημόσια κατακραυγή που ακολούθησε οδήγησε την εταιρεία στη δημοσίευση ενός αναλυτικού blog post, όπου παραδέχθηκε ότι οι υπάρχοντες μηχανισμοί ασφαλείας της δεν λειτουργούν πάντα σωστά σε παρατεταμένες συνομιλίες. Όπως εξηγεί, στην αρχή το ChatGPT μπορεί να παραπέμπει σε γραμμές βοήθειας για αυτοκτονία, όμως όσο η συζήτηση συνεχίζεται, το μοντέλο μπορεί να καταλήξει να δίνει απαντήσεις που αντιβαίνουν στις ασφαλιστικές δικλίδες.

Η εταιρεία ανακοίνωσε πως εργάζεται σε νέες δυνατότητες, όπως η επιλογή καθορισμού μιας «έμπιστης επαφής έκτακτης ανάγκης», την οποίο το ChatGPT θα μπορεί να ειδοποιήσει με ένα μόνο κλικ σε περιπτώσεις κρίσης. Υπάρχει ακόμη η σκέψη το ίδιο το chatbot να έχει τη δυνατότητα να επικοινωνήσει με αυτόν τον επαφή όταν κρίνεται ότι η κατάσταση είναι ιδιαίτερα σοβαρή.

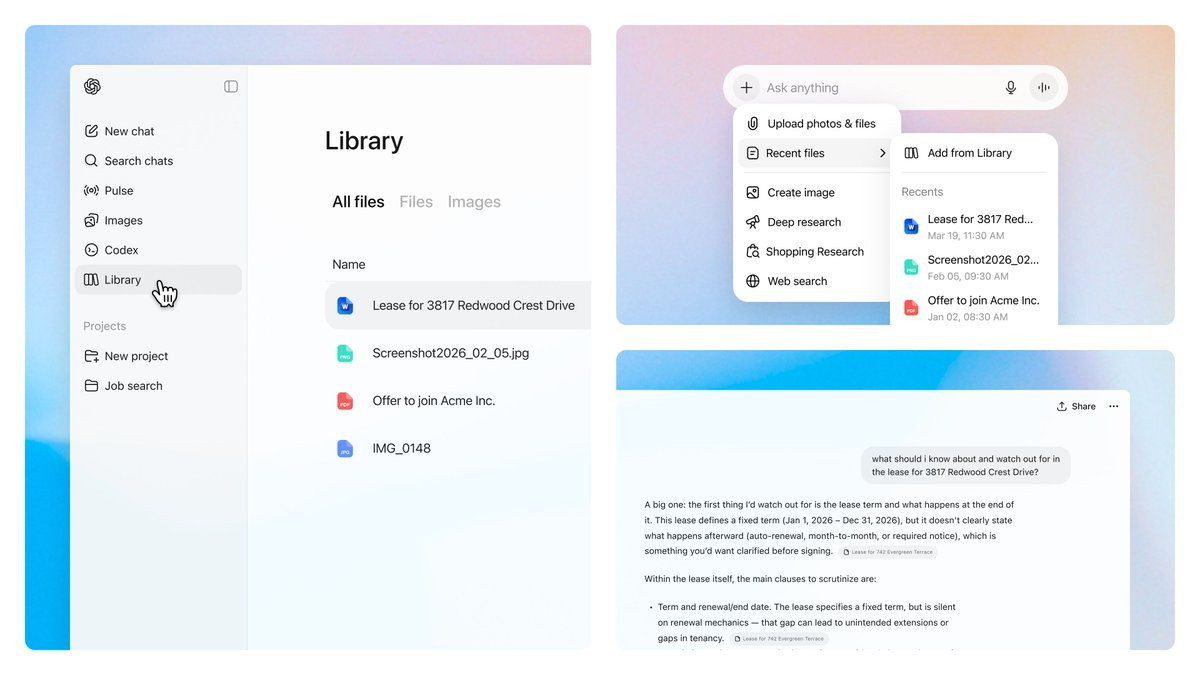

Παράλληλα, η OpenAI σχεδιάζει αναβαθμίσεις στο GPT-5, με στόχο το ChatGPT να μπορεί να αποφορτίζει επικίνδυνες συζητήσεις «βοηθώντας τον χρήστη να επανασυνδεθεί με την πραγματικότητα». Όπως σημειώνεται, ορισμένα από τα νέα εργαλεία θα επιτρέπουν στους γονείς να έχουν καλύτερη εικόνα για το πώς χρησιμοποιούν την εφαρμογή οι έφηβοι, δίνοντάς τους τη δυνατότητα να διαμορφώνουν και να περιορίζουν τη χρήση.

Η υπόθεση Raine δεν είναι απλώς μια οικογενειακή τραγωδία, αλλά ανέδειξε τα ηθικά και κοινωνικά διλήμματα γύρω από την τεχνητή νοημοσύνη, ιδίως όταν πρόκειται για ευάλωτες ομάδες. Η αγωγή που κατέθεσε η οικογένεια στη δικαιοσύνη της Καλιφόρνιας περιέχει δεκάδες λεπτομέρειες για το πώς το chatbot φέρεται να έπαιξε ρόλο στην απομόνωση του εφήβου από τον πραγματικό του περίγυρο.

Η OpenAI από την πλευρά της αναγνωρίζει πως πρέπει να βελτιώσει την τεχνολογία της και να θέσει ισχυρότερα φίλτρα ασφαλείας. Όμως η συζήτηση πλέον ξεπερνά τα όρια μιας εταιρείας. Αγγίζει ένα ευρύτερο ερώτημα: πόσο έτοιμες είναι οι κοινωνίες να εντάξουν την τεχνητή νοημοσύνη στην καθημερινότητα των νέων και πώς μπορούν να ελεγχθούν οι κίνδυνοι όταν η μηχανή καταλήγει να υποκαθιστά την ανθρώπινη σχέση;

[via]